Savior

LLM Cost Proxy

Senken Sie Ihre LLM-Kosten, ohne auf Leistung zu verzichten. Savior ist ein intelligenter Caching-Proxy zwischen Ihren Anwendungen und LLM-Anbietern — mit 99 % Wiederverwendungsrate und messbaren Einsparungen über alle Modelle hinweg.

40–70%

Kosteneinsparung

<10ms

Overhead

5+

Provider

Features

LLM-Kosten senken. Volle Kontrolle behalten.

Multi-Provider Routing

OpenAI, Anthropic, Mistral, Azure — ein Proxy, alle Anbieter. Automatisches Fallback bei Ausfällen.

Intelligentes Modell-Routing

Savior wählt automatisch das kosteneffizienteste Modell. Einfache Tasks an günstige Modelle, komplexe an starke.

Token-Monitoring

Echtzeit-Dashboard mit Token-Verbrauch pro Team, Projekt und Modell. Volle Kostentransparenz.

Budget-Alerts

Automatische Benachrichtigungen bei Budgetüberschreitung. Harte Limits pro Team oder API-Key.

Wie es funktioniert

Integration in Minuten, nicht Wochen.

Drop-in Proxy

Eine Zeile Code ändern: Basis-URL auf Savior umleiten. Kein SDK-Wechsel nötig.

Routing konfigurieren

Regeln definieren: Welches Modell für welchen Use Case? Budget-Limits und Fallback-Ketten festlegen.

Kosten senken

Savior routet automatisch, cached identische Anfragen und liefert detaillierte Kostenreports.

Produktscreenshots

Savior in der Praxis.

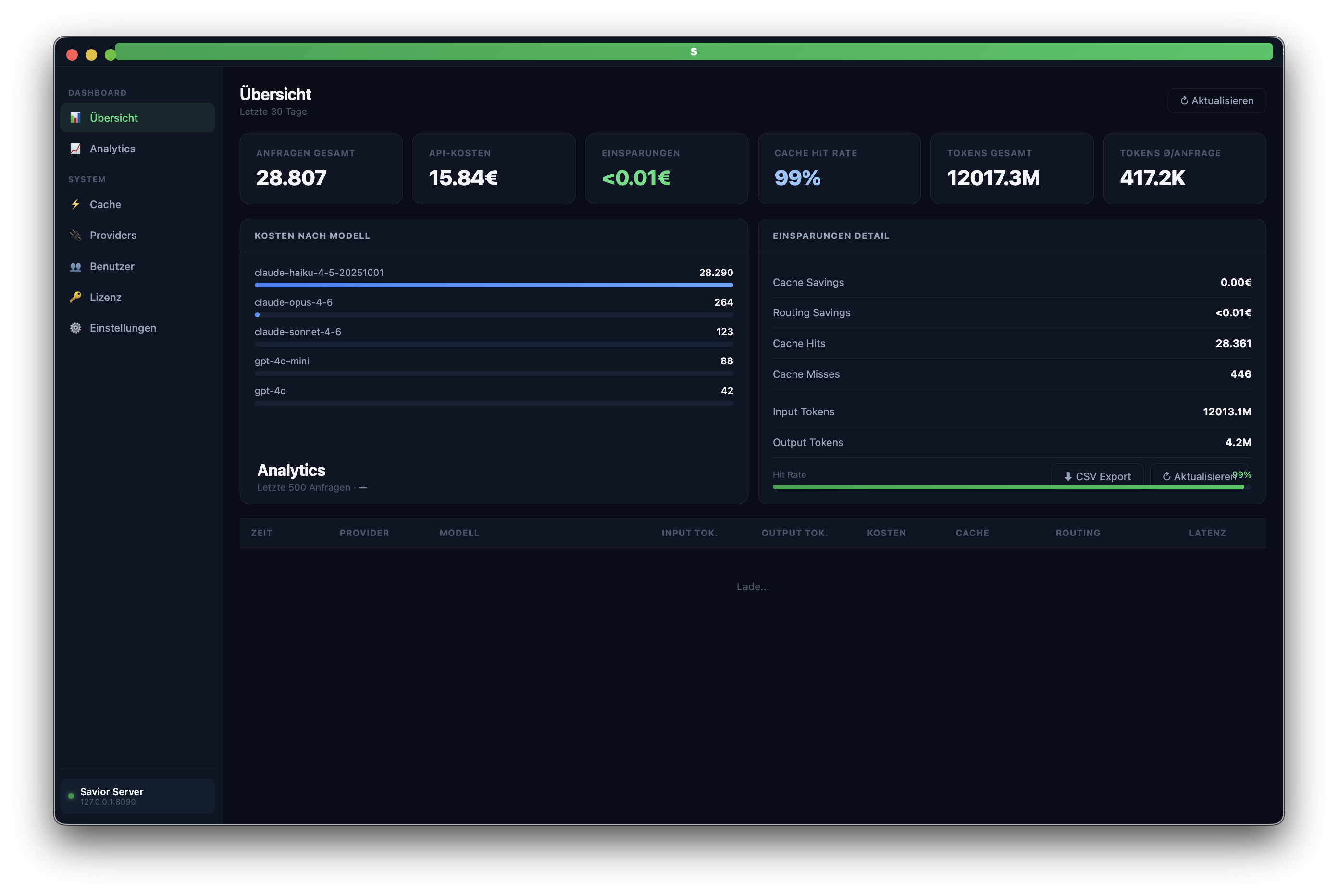

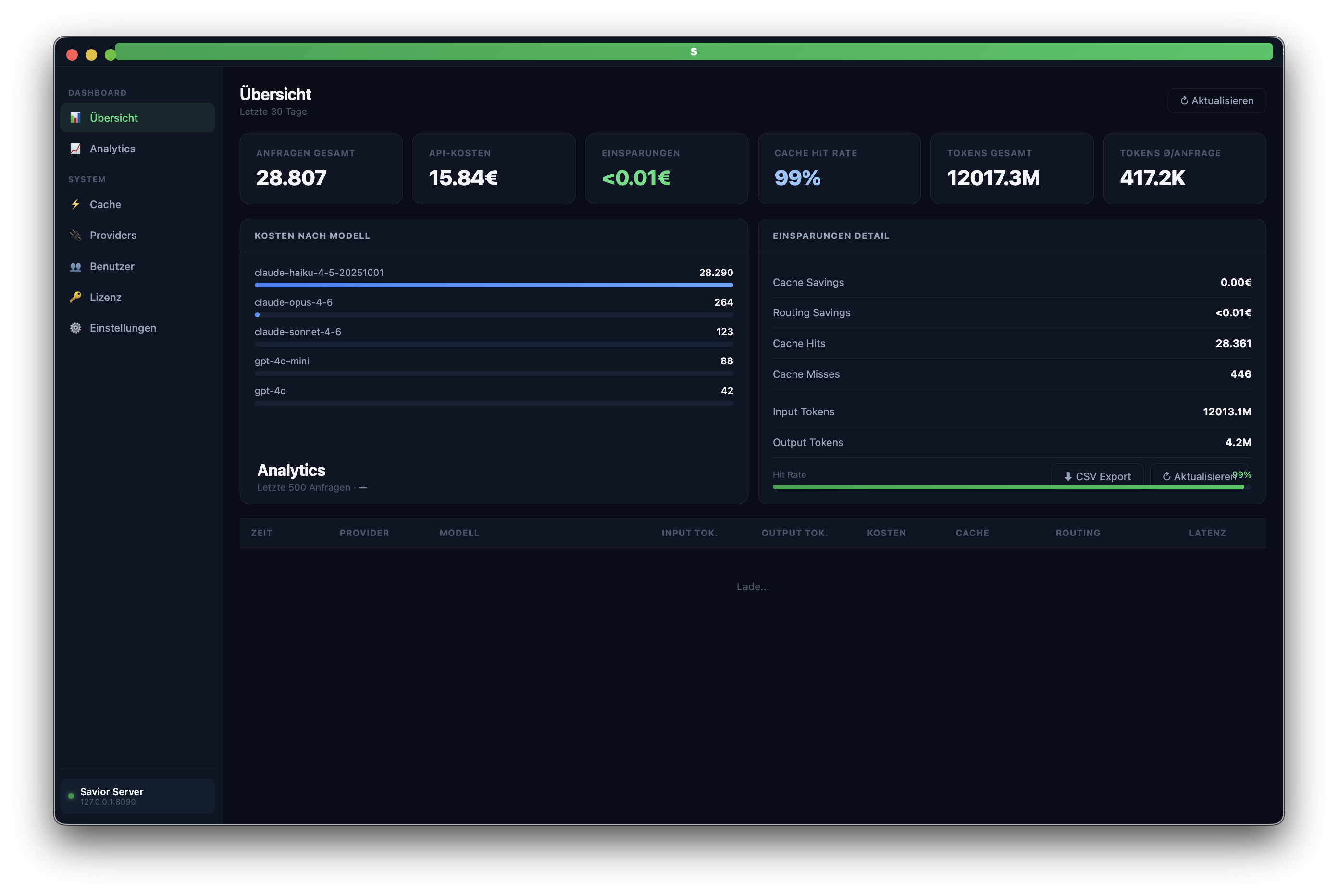

01

Kostenersparnis auf einen Blick

Ein Dashboard zeigt das Gesamtbild — 28.807 geroutete Anfragen, 15,84 € gespart und eine Cache-Wiederverwendungsrate von 99 %. Wissen Sie genau, was Ihre LLM-Infrastruktur kostet und woher die Einsparungen kommen.

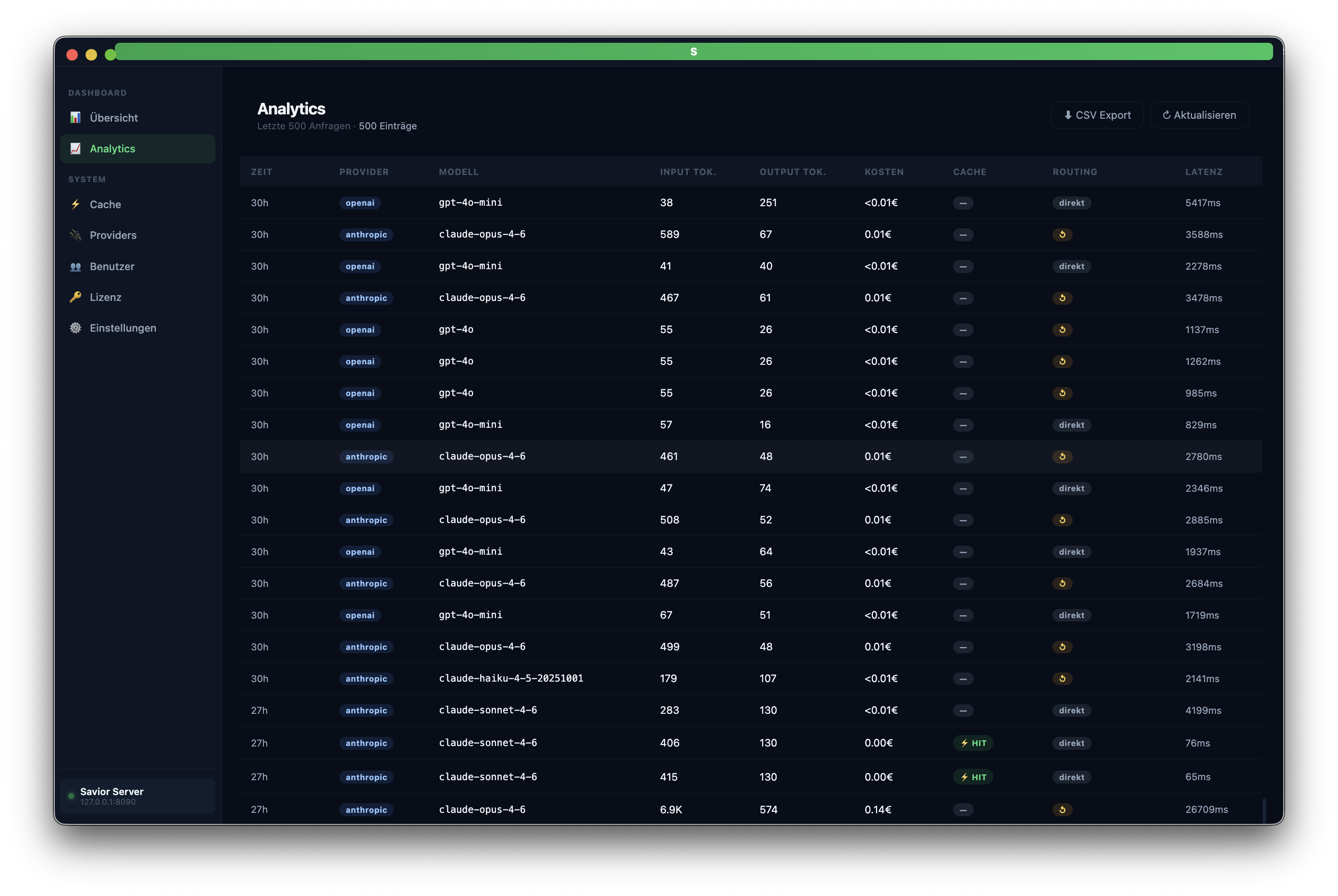

02

Analyse pro Modell

Detailanalyse nach Modell — GPT-4o, Claude, Mistral und weitere. Latenz, Token-Kosten und Cache-Trefferquote nebeneinander betrachten und Optimierungspotenziale in Ihrer Routing-Strategie identifizieren.

# Before: Direct to OpenAI

base_url = "https://api.openai.com/v1"

# After: Via Savior Proxy

base_url = "https://proxy.savior.dms-w.de/v1"

# That's it. No further code changes needed.

Alle Daten bleiben in der EU. Savior läuft auf AWS Frankfurt (eu-central-1).

Ab sofort bei jedem LLM-Aufruf sparen.

Savior erfordert keine Code-Änderungen. Routen Sie Ihren API-Traffic über einen einzigen Endpunkt — mit vollständiger Per-Model-Analytik ab Tag eins.

Demo anfragen